اولین رباتی که در فیلمها آنها را دیدم، رزی از کارتون جتسونها بود و بعد از آن، C-3PO و دستیارش R2-D2 در فیلم جنگ ستارگان! اما اولین هوش مصنوعی بدون بدن که با آن آشنا شدیم، جاشوا، کامپیوتر فیلم “بازیهای جنگ” بود که سعی کرد جنگ هستهای را آغاز کند!

اما همیشه چندین سوال ذهن همه را درگیر کرده است، آیا یک ماشین میتواند اخلاق، احساسات و انسانیت را درک کند؟ آیا هوش مصنوعی به بدن نیاز دارد؟ این شیفتگیها با پیچیدگی فزاینده هوش غیرانسانی، با شخصیتهایی مانند اندروید بیشاپ در “بیگانگان”، دیتا در “پیشتازان فضا: نسل بعدی” و اخیراً سامانتا در “او” یا اوا در “اکس ماکینا” عمیقتر شدند.

اما اینها دیگر فقط سؤالات نظری نیستند. امروزه متخصصان رباتیک با این سؤال دست و پنجه نرم میکنند که آیا هوش مصنوعی به بدن نیاز دارد؟ و اگر بله، چه نوع بدنی؟!

و سپس “چگونگی” همه اینها مطرح میشود؛ اگر هوش تجسمیافته، راه پیشرفت به سوی هوش عمومی مصنوعی (AGI) واقعی باشد، آیا رباتهای انساننما میتوانند کلید این گام بعدی باشند؟!

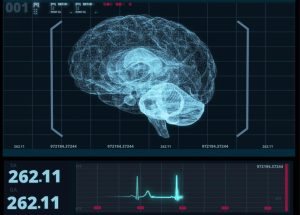

محدودیتهای هوش مصنوعی بدون بدن

مقالات اخیر شروع به نشان دادن کاستیها در پیشرفتهترین سیستمهای هوش مصنوعی امروزی (و به ویژه بدون بدن) کردهاند. یک مطالعه جدید از اپل، “مدلهای استدلال بزرگ” (LRM) را بررسی کرد – مدلهای زبانی که قبل از پاسخ دادن، مراحل استدلال را تولید میکنند. این سیستمها، همانطور که مقاله اشاره میکند، در بسیاری از وظایف بهتر از LLMهای استاندارد عمل میکنند، اما وقتی مشکلات بیش از حد پیچیده میشوند، از هم میپاشند. به طرز حیرتانگیزی، آنها فقط متوقف نمیشوند – بلکه سقوط میکنند، حتی زمانی که قدرت محاسباتی بیش از حد کافی به آنها داده میشود.

بدتر از آن، آنها در استدلال ثابت یا الگوریتمی شکست میخورند. “ردپاهای استدلال” آنها – یعنی نحوه حل مشکلاتشان – فاقد منطق داخلی است و هرچه چالش پیچیدهتر باشد، به نظر میرسد مدلها تلاش کمتری از خود نشان میدهند. نویسندگان نتیجه میگیرند که این سیستمها واقعاً مانند انسان “فکر” نمیکنند.

نیک فراست، محقق سابق گوگل و از بنیانگذاران Cohere، به نیویورک تایمز گفت:

آنچه ما اکنون میسازیم، چیزهایی هستند که کلمات را دریافت میکنند و محتملترین کلمه بعدی را پیشبینی میکنند… این با آنچه انسانها انجام میدهند بسیار متفاوت است!

شناخت فراتر از صرفاً محاسبه است!

چگونه به اینجا رسیدیم؟ در بیشتر قرن بیستم، هوش مصنوعی از مدلی به نام GOFAI پیروی میکرد – “هوش مصنوعی قدیمی خوب” – که شناخت را به عنوان منطق نمادین در نظر میگرفت. محققان اولیه هوش مصنوعی معتقد بودند که هوش را میتوان با پردازش نمادها ساخت، بسیار شبیه به نحوه اجرای کد توسط یک کامپیوتر. تفکر انتزاعی و مبتنی بر نماد قطعاً برای پیشرفت نیازی به بدن ندارد.

این ایده زمانی شروع به از هم پاشیدن کرد که هوش مصنوعی رباتهای اولیه نتوانستند شرایط آشفته و واقعی را مدیریت کنند. محققان در روانشناسی، علوم اعصاب و فلسفه شروع به طرح سؤال متفاوتی کردند که ریشه در درکهای بزرگتری داشت که از مطالعات هوش حیوانات و گیاهان به دست آمد و همگی با شرایط پیچیده محیطی سازگار میشوند، یاد میگیرند و به آن پاسخ میدهند. این موجودات از طریق تعاملات فیزیکی یاد میگیرند، نه ایدههای نمادین.

در انسانها، سیستم عصبی رودهای که روده ما را کنترل میکند، اغلب “مغز دوم” نامیده میشود، زیرا از همان نوع سلولها و مواد شیمیایی استفاده میکند که مغز برای کمک به هضم ما استفاده میکند – همچنین، اتفاقاً، اینها همان اجزایی هستند که شاخک اختاپوس برای حس کردن و واکنش محلی، در داخل اندام استفاده میکند.

اینها همه این سؤال را مطرح میکنند که، چه میشود اگر اساس هوش سازگار این باشد که در سراسر یک ارگانیسم توزیع شده است و فقط در مغز، جدا از دنیای فیزیکی، زندگی نمیکند؟

این ایده اصلی شناخت تجسم یافته است. عمل، حس کردن و تفکر جدا از هم نیستند – آنها یک فرآیند هستند. همانطور که رولف فایفر، مدیر آزمایشگاه هوش مصنوعی دانشگاه زوریخ به EMBO Reports گفت:

مغزها همیشه در بستر بدنی که برای بقا با جهان تعامل دارد، رشد کردهاند. هیچ اتمسفر الگوریتمی وجود ندارد که مغزها در آن به وجود بیایند.

هوش تجسم یافته: نوعی متفاوت از تفکر

پس ممکن است به بدنهای هوشمندتر برای همراهی با هوش مصنوعی نیاز داشته باشیم، و سسیلیا لاشی، پیشگام در رباتیک نرم، فکر میکند که هوشمندتر به معنای نرمتر است. پس از سالها کار با رباتهای انساننمای صلب در ژاپن، او تحقیقات خود را به ماشینهای نرمبدن تغییر داد، با الهام از اختاپوس – حیوانی که اسکلت ندارد و اندامهایش خودشان فکر میکنند.

او در مصاحبهای با New Atlas میگوید:

اگر یک ربات انساننما در حال راه رفتن داشته باشید، تمام حرکات مختلف را کنترل میکنید. اگر چیزی متفاوت در زمین وجود داشته باشد، باید کمی دوباره برنامهریزی کنید.

اما حیوانات نیازی به بازاندیشی و برنامهریزی حرکات راه رفتن خود ندارند. او توضیح میدهد:

زانو ما انعطافپذیر است. ما ناهماهنگی زمین را به صورت مکانیکی جبران میکنیم، بدون استفاده از مغز. این هوش تجسم یافته است – این ایده که برخی از عناصر شناخت را میتوان به بدن واگذار کرد.

هوش تجسم یافته از منظر مهندسی مزایای آشکاری دارد؛ واگذاری درک، کنترل و تصمیمگیری به ساختار فیزیکی ربات به معنای کاهش تقاضاهای محاسباتی در مغز اصلی ربات است که منجر به ماشینهایی میشود که میتوانند در محیطهای غیرقابل پیشبینی مؤثرتر عمل کنند.

در یک شماره ویژه ماه می Science Robotics، لاشی آن را اینگونه تعریف میکند:

کنترل حرکتی به طور کامل توسط سیستم محاسباتی مدیریت نمیشود… رفتار حرکتی تا حدی به صورت مکانیکی توسط نیروهای خارجی که بر بدن وارد میشوند، شکل میگیرد. رفتار توسط محیط شکل میگیرد و هوش از طریق تجربه آموخته میشود، نه اینکه از قبل در نرمافزار برنامهریزی شود.

با این طرز تفکر، هوش فقط به معنای تراشههای سریعتر یا مدلهای بزرگتر نیست – بلکه به معنای تعامل است. کلید پیشبرد این هوش، رشته رباتیک نرم است که از موادی مانند سیلیکون یا پارچههای خاص برای ایجاد بدنههای ربات انعطافپذیرتر استفاده میکند. این بدنها سازگار، سیال و قادر به یادگیری در لحظه هستند. یک بازوی رباتیک نرم، مانند شاخک اختاپوس، میتواند بدون نیاز به محاسبه هر حرکت، بگیرد، کاوش کند و پاسخ دهد.

گوشت و بازخورد: چگونه مواد را وادار کنیم که خودشان فکر کنند؟

با این حال، برای اینکه رباتیک نرم به خوبی یک شاخک عمل کند، متخصصان رباتیک باید از برنامهریزی برای هر احتمالی فاصله بگیرند و به جای آن راههای جدیدی برای حس کردن و واکنش نشان دادن ماشینها طراحی کنند. برای ساخت ماشینهایی با خودمختاری شبه زندگی، محققان به مفهوم جدیدی روی آوردهاند: هوش فیزیکی خودمختار (API).

شیمین هی، دانشیار علوم و مهندسی مواد در UCLA، کارهای پیشگامانهای در این زمینه انجام داده است و مواد نرم – مانند ژلها و پلیمرهای واکنشپذیر – را طراحی کرده است که نه تنها به محرکها واکنش نشان میدهند، بلکه با استفاده از بازخورد داخلی، حرکت خود را نیز تنظیم میکنند.

هی در مصاحبهای با New Atlas میگوید:

ما روی ایجاد توانایی تصمیمگیری بیشتر در سطح مواد کار کردهایم. موادی که در پاسخ به یک محرک تغییر شکل میدهند، میتوانند ‘تصمیم بگیرند’ که چگونه آن محرک را بر اساس نحوه تغییر شکل خود تنظیم کنند – حرکت بعدی خود را تصحیح یا تنظیم کنند.

در سال 2018، آزمایشگاه هی این را با یک ژل نشان داد که میتوانست حرکت خود را تنظیم کند. از آن زمان، آنها نشان دادهاند که همین اصل در طیف وسیعی از مواد نرم، از جمله الاستومرهای کریستال مایع که به طور مؤثر در هوا کار میکنند، نیز صدق میکند.

کلید API، بازخورد غیرخطی با تأخیر زمانی است. در رباتهای سنتی، یک سیستم کنترل دادههای حسی را تجزیه و تحلیل میکند و به ماشین میگوید چه کاری انجام دهد. رویکرد هی این منطق را مستقیماً در خود مواد تعبیه میکند.

هی توضیح میدهد:

در رباتیک، به حسگر و عملگر نیاز دارید – اما همچنین به تصمیمگیری بین آنها. این همان چیزی است که ما به صورت فیزیکی، با استفاده از حلقههای بازخورد، تعبیه میکنیم.

هی این را با سیستمهای بیولوژیکی مقایسه میکند. بازخورد منفی، مانند تنظیم گلوکز یا ترموستات ما، برای اصلاح افزایش بیش از حد عمل میکند. بازخورد مثبت تغییر را تقویت میکند. بازخورد غیرخطی هر دو را ترکیب میکند و امکان رفتارهای کنترل شده و ریتمیک را فراهم میکند – مانند آونگ یا راه رفتن.

او میگوید:

بسیاری از حرکات طبیعی – مانند راه رفتن یا شنا کردن – به حرکت منظم و ثابت متکی هستند. با بازخورد غیرخطی و با تأخیر زمانی، میتوانیم رباتهای نرمی را طراحی کنیم که به جلو، عقب، دوباره به جلو حرکت کنند – بدون نیاز به کنترل خارجی در هر گام.

این نشان دهنده یک گام بزرگ رو به جلو از رباتهای نرمی است که برای عملکرد به محرکهای خارجی متکی هستند، همانطور که هی و همکارانش در یک مقاله مروری اخیر به اشتراک گذاشتند. با ادغام حسگری، کنترل و عملگر در خود ماده، محققانی مانند هی راه را برای ماشینهایی هموار میکنند که نه تنها واکنش نشان میدهند، بلکه خودشان تصمیم میگیرند، سازگار میشوند و عمل میکنند.

آینده نرم (و هوشمند) است!

رباتیک نرم یک رشته نوپا است، اما وعده عمیقی دارد. لاشی به ابزارهای جراحی مانند آندوسکوپها اشاره میکند که میتوانند همزمان بافت حساس انسانی را بررسی کرده و به آن واکنش نشان دهند، یا دستگاههای توانبخشی که میتوانند برای نیازهای بیمار منعطف یا سازگار شوند، به عنوان کاربردهای اولیه و آشکار.

بنابراین، برای حرکت از هوش مصنوعی به هوش عمومی مصنوعی، ماشینها ممکن است به بدن نیاز داشته باشند – به طور خاص، بدنهای نرم و سازگار. بیشتر حیات روی زمین، از جمله انسانها، با حرکت، لمس، شکست خوردن و تنظیم یاد میگیرد. ما میدانیم چگونه با دنیایی غیرقابل پیشبینی و پر هرج و مرج کنار بیاییم – چیزی که هوش مصنوعی امروزی هنوز با آن دست و پنجه نرم میکند. ما میدانیم سیب چیست، نه به این دلیل که تعریفی از آن خواندهایم، بلکه به این دلیل که آن را در دست گرفتهایم، طعم آن را چشیدهایم، آن را انداختهایم، کبود کردهایم، بریدهایم، فشردهایم، و پوسیدنش را دیدهایم.

این نوع دانش – ضمنی، حسی، متنی – برای مدلی که فقط متن یا پیکسلها را دیده است، دشوار است. ارتباط مستقیم با دنیای واقعی و بازخورد از آن، محدودیتهای زبانی را که LLMها در حال حاضر با آن دست و پنجه نرم میکنند، از بین میبرد و پتانسیل هوش مصنوعی را برای ساخت درکی متفاوت از جهان ارائه میدهد. تصوری از جهان از دیدگاه خودش، نه یک دیدگاه انسانی، بلکه چیزی متفاوت. اگر یک ربات نرم با انواع مختلف ورودیهای حسی (مانند دید مادون قرمز، شنوایی فرکانس پایین، یا توانایی بوییدن سرطان یا سایر بیماریها) فراهم شود، حتی میتواند درکی جایگزین (و احتمالاً فوقالعاده مفید) از زندگی روی زمین ایجاد کند.

جولیو ساندینی، استاد مهندسی زیستی در دانشگاه جنوا ایتالیا به EMBO Reports گفت:

اگر میخواهید چیزی شبیه به هوش انسانی را در یک ماشین توسعه دهید، ماشین باید بتواند تجربیات خود را کسب کند. شما باید به آن اجازه دهید از تجربه بیاموزد، همانطور که کودکان یاد میگیرند. و این احتمالاً به بدن نیاز دارد.

منبع: Newatlas